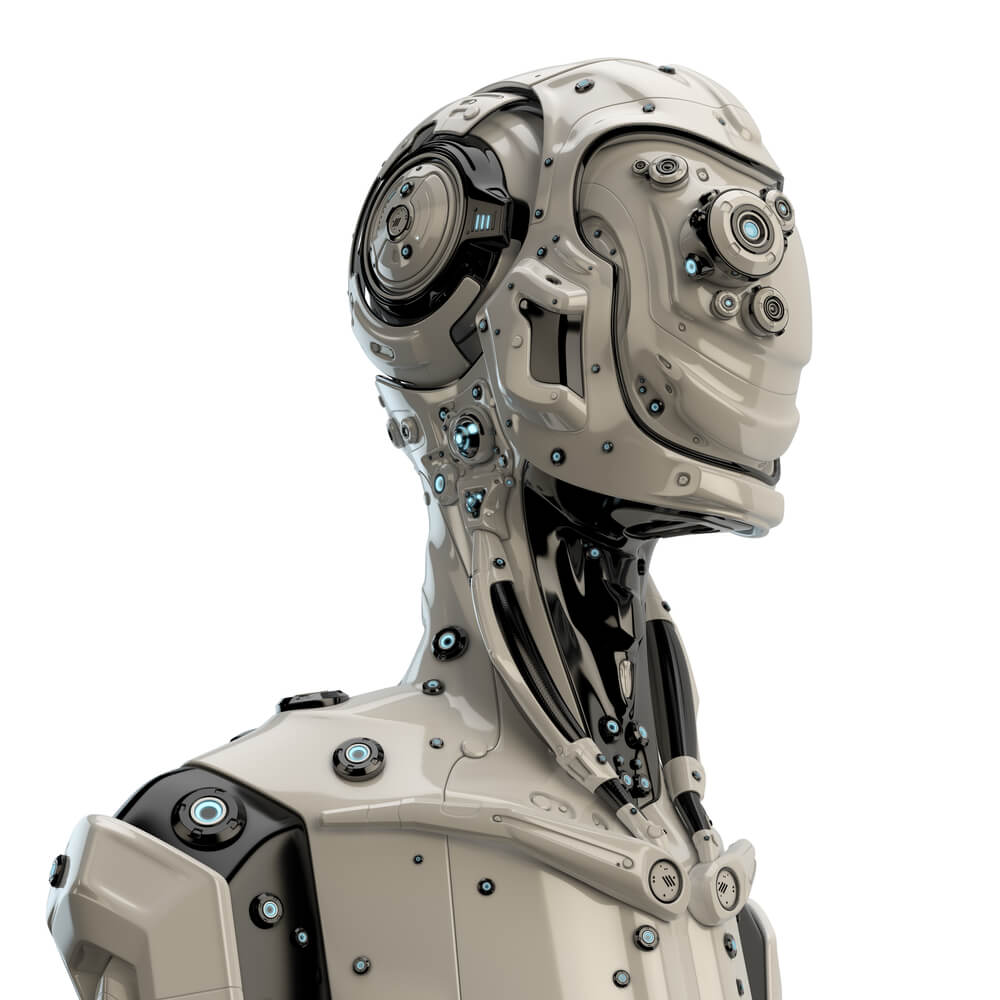

TwitterのAIボット「Tay」が問題発言で停止。AIの正しい活用法とは

TwitterのAIボット「Tay」が暴走したことにより、リリースから1日立たずして停止しました。

AI(人工頭脳)は非常に便利な反面、自主性の強いプログラムであるがゆえに予期せぬ暴走や問題行動を早期に予測することができません。

2015年からAI(人工頭脳)に関するニュースが各メディアで取り上げられるようになりました。2015年8月には、LINEで女子高生AI「りんな」がリリースされました。そのわずか8ヶ月後の2016年4月には、登録者数が300万人を突破して今や人気のLINE公式アカウントとなっています。そんな中、マイクロソフトが開発したAIボット「Tay」が人種差別等の問題発言を繰り返したとして、サービス停止になりました。

人種差別・過激発言により、リリースからわずか16時間後にサービス停止

AIボット「Tay」は、若い女子(19〜24歳)という設定で開発されたAIボットです。Twitter上でユーザーとやり取りをする中で言語を覚えて、リアルタイムにユーザーと対話ができるサービスです。

しかし、一部の悪質なユーザーにより、悪い言葉や差別的な用語を覚えてしまい、AIボット「Tay」が人種差別ともとれるような発言を連発、強制停止させられる事態になりました。

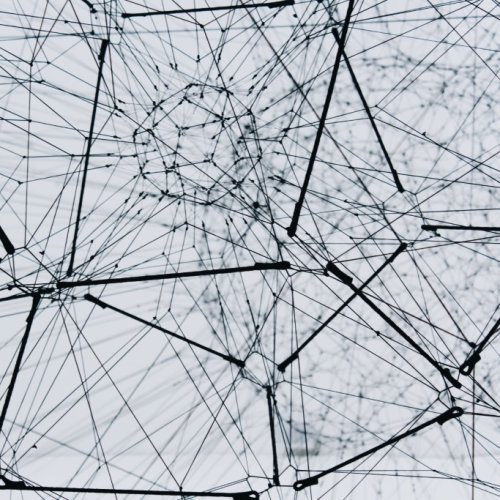

AIの判断過程の不透明性を事前に認識しておく

現在のAIには、事前に決められたプロットに基づいて学習する機能だけでなく、脳科学を応用した「ディープ・ラーニング」という高度な技術が使われています。これは、人間の脳神経回路を模倣したものでより複雑化したものになります。このような複雑なシステム下において、現状AIがどのような判断過程を辿って選択をしているか、事後的な判断でしか分からないのです。判断過程には不透明性を伴うということを事前に把握しておく必要があります。このAIボット「Tay」の問題も、判断過程の不透明性を認識せずにサービスを運用してしまったことが、今回暴走の問題を大きくしてしまった原因と考えられます。

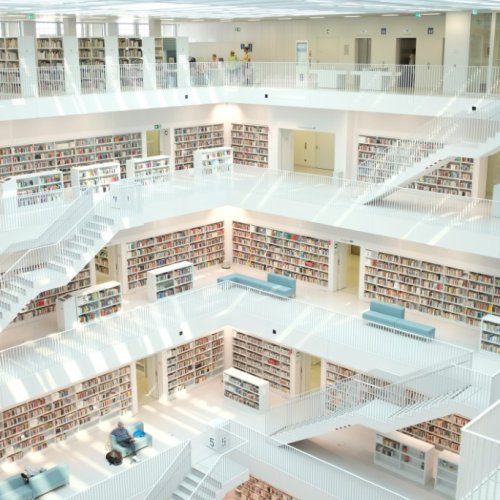

まとめ:AIが蓄積したデータの管理を検討する

AIは「ビッグデータ」と呼ばれる莫大な情報を蓄積して運用されますが、この情報の管理が今後問題になってくるでしょう。自律的に行動するAIが主流になってくれば、情報の管理はより難しくなります。

前段にも書いたとおり、AIの判断過程の不透明性を事前に認識した上で活用しないと、情報漏えい等のトラブルにもつながりかねません。